OpenProject와 GitHub의 연동을 위해 이전의 포스팅에서 다룬 방법은 OpenProject의 task ticket에있는 Git snippets의 내용을 복사해서 터미널에 붙여넣는 것이었는데, 이 때 만들어지는 branch의 이름은 OpenProject ticket의 제목에 기반한 것이어서 자칫하면 branch의 이름이 지나치게 길어지는 데다가, 사전에 정해둔 팀내의 branch naming rule과 충돌하기 쉽다.

다행히도 OpenProject의 GitHub 자동 연동기능은 branch naming명이 아닌 커밋 메세지내에 있는 issue ticket link에 의해 연결는 것이어서 branch의 이름은 Git snippets에서 제안하는 것과 달라도 문제가 없다.

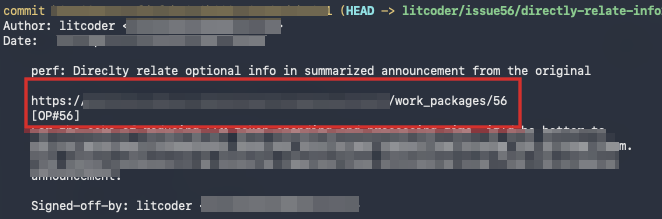

수정 사항을 만들고 나서 commit message를 작성할 때 OpenProject의 issue ticket link을 걸어 주면 Git snippets의 내용을 복사하지 않더라도 GitHub와 연동이 잘 되는 것을 볼 수 있다. 혹시 있을 오류를 대비해서 Commit의 내용에도 [OP#56] 처럼 OpenProject내의 task ticket 번호를 언급해 주기는 했으나 이것은 없어도 아무런 문제가 없다.

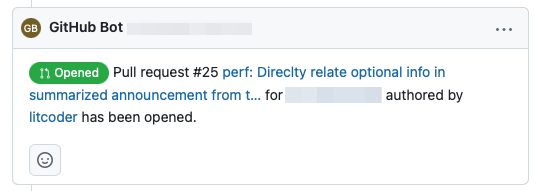

GitHub에서 PR을 생성한 후 OpenProject의 해당 ticket을 보면 PR의 상태를 잘 받아서 상태를 보여주고 있는 것이 보인다.

결론

OpenProject의 Git snippet은 유용한 template이기는 하나 팀내의 다른 branch naming이나 commit message 작성에 관한 규칙이 있다면 굳이 따를 필요는 없다. Commit message내에 OpenProject의 ticket과 link시키기 위한 URL을 넣어 주면 알아서 동기화가 이루어 진다.